The trends

Rất nhiều người đang mắc “hội chứng phụ thuộc AI” – tin rằng AI luôn-đúng vì chúng “thông minh”. Nhưng thực tế, AI là một cỗ máy dự đoán xác suất, không phải là một cỗ máy chân lý.

Tổng quan

Mục tiêu: Giải mã hiện tượng “ảo giác AI” (Hallucination), xác định những lĩnh vực “cấm kỵ” khi hỏi AI, và trang bị tư duy phản biện (Critical Thinking) khi tiếp nhận câu trả lời.

Vì sao không nên bỏ qua: Việc tin tưởng mù quáng vào AI có thể dẫn đến những sai lầm nghiêm trọng trong ra quyết định kinh doanh, tư vấn pháp lý hoặc sức khỏe.

Đối tượng phù hợp: Người làm nội dung (Content Creators), Nghiên cứu sinh, Quản lý dự án và bất kỳ ai đang dùng AI để tìm kiếm thông tin.

Lưu ý: Các mô hình AI đang được cập nhật liên tục, nhưng bản chất “dự đoán từ ngữ” vẫn không thay đổi. Luôn giữ tâm thế hoài nghi lành mạnh.

1. Bản chất: AI không "hiểu", nó chỉ đang "đoán"

Để sử dụng AI hiệu quả, bạn cần hiểu cơ chế cốt lõi của các Mô hình Ngôn ngữ Lớn (LLMs). Khi bạn hỏi: “Thủ đô của Pháp là gì?”, AI không tra cứu một cuốn từ điển trong đầu nó. Thay vào đó, nó tính toán xác suất: “Sau từ ‘Thủ đô’, từ ‘của’, từ ‘Pháp’, thì từ nào có khả năng xuất hiện tiếp theo cao nhất?”. Câu trả lời là “Paris”.

Chính vì cơ chế này, AI rất dễ mắc phải “Ảo giác” – hiện tượng AI tự bịa ra thông tin sai lệch nhưng trình bày với giọng văn cực kỳ tự tin và thuyết phục.

Số liệu dẫn chứng: Theo bảng xếp hạng “Hallucination Leaderboard” của Vectara (Công bố tháng 11/2023), ngay cả các mô hình AI hàng đầu cũng có tỷ lệ tạo ra thông tin sai lệch dao động từ 3% đến 27% tùy thuộc vào tác vụ. Điều này có nghĩa là trong 100 câu trả lời, có thể có tới gần 30 câu chứa thông tin không chính xác.

"Hãy sử dụng AI với một cái đầu lạnh và một tư duy luôn đặt câu hỏi: "Thông tin này có thực sự đúng không?"."

2. Ba vùng "Tử địa": Những điều không nên hỏi và tin tuyệt đối

Có những lĩnh vực mà sai sót không chỉ là lỗi typo, mà là hậu quả thực tế. Hãy thận trọng tối đa ở 3 khu vực sau:

A. Tư vấn y tế và chẩn đoán bệnh

AI có thể liệt kê triệu chứng, nhưng nó không thể chẩn đoán.

Rủi ro: AI có thể đưa ra lời khuyên dựa trên các bài báo cũ, chưa được kiểm chứng y khoa, hoặc tệ hơn là “bịa” ra các phương pháp điều trị không tồn tại.

Lời khuyên: Chỉ dùng AI để tìm hiểu khái niệm y khoa, không dùng để chẩn đoán hay kê đơn.

B. Tư vấn pháp lý và trích dẫn luật

Đây là cái bẫy chết người mà nhiều người đã mắc phải.

Dẫn chứng thực tế: Vào tháng 6/2023, báo The New York Times đã đưa tin về một luật sư tại Mỹ bị phạt vì sử dụng ChatGPT để soạn thảo văn bản pháp lý. AI đã trích dẫn 6 vụ án hoàn toàn không có thật (do nó tự bịa ra) để làm bằng chứng trước tòa.

Bài học: AI rất giỏi bịa ra các điều luật nghe có vẻ hợp lý nhưng sai hoàn toàn về số hiệu và nội dung.

C. Các dữ liệu/ Sự kiện thời gian thực (Real-time Events)

Trừ khi bạn sử dụng các công cụ có kết nối Search (như Perplexity hay ChatGPT Plus có Browsing), đừng hỏi AI về giá vàng sáng nay, tỷ số trận bóng vừa xong hay giá cổ phiếu hiện tại.

Lý do: Kiến thức của AI bị giới hạn bởi thời điểm cắt dữ liệu (Knowledge Cutoff).

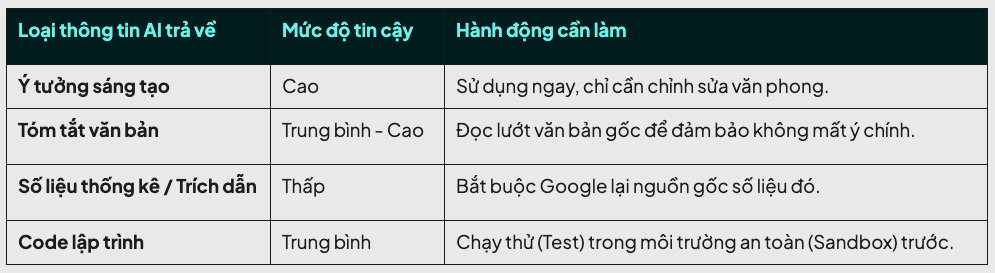

3. Chiến thuật "tin nhưng kiểm chứng"

Khuyến khích bạn dùng AI để tăng tốc, không phải để thay thế tư duy. Hãy áp dụng quy trình sau:

4. Lời khuyên cho người làm việc chuyên nghiệp

Đừng để sự tiện lợi của AI làm mòn tư duy phản biện của bạn.

Yêu cầu trích nguồn: Khi hỏi AI về thông tin, hãy thêm vào prompt: “Vui lòng trích dẫn nguồn cụ thể (URL/Tên báo cáo) cho các số liệu này”. Nếu AI không đưa ra được nguồn, hãy coi chừng.

Kiểm tra chéo (Cross-check): Sử dụng 2 mô hình AI khác nhau (ví dụ: hỏi cả ChatGPT và Gemini) để xem kết quả có đồng nhất không.

Giữ quyền quyết định: Hãy coi AI là một thực tập sinh nhiệt tình nhưng hay lơ đễnh. Bạn là sếp, và bạn chịu trách nhiệm cuối cùng về mọi “chữ ký” của mình.

Tạm kết

AI là một công cụ khuếch đại khả năng của con người, nhưng nó cũng khuếch đại cả sự sai lệch nếu chúng ta thiếu tỉnh táo. Sự thông thái không nằm ở câu trả lời của AI, mà nằm ở khả năng thẩm định của người đặt câu hỏi.

Hãy sử dụng AI với một cái đầu lạnh và một tư duy luôn đặt câu hỏi: “Thông tin này có thực sự đúng không?”.

Miễn trừ trách nhiệm (Disclaimer): Đây là nội dung có sự tham gia của AI, chỉ mang tính tham khảo và không thể không có thiếu sót. Nếu cần đóng góp những thông tin sai hoặc liên hệ tham vấn thêm, hãy gửi email đến địa chỉ [email protected] để được hỗ trợ.